街拍丝袜 AI 算法、算力与体捆绑构的跳动

咱们皆知谈大模子皆是由多样算法构成的街拍丝袜,那若何看似简便的代码,若何酿成让东谈主惊艳的“智能大脑”的?这篇著述,咱们来分析下算法、结构的路程和跳动。

你有莫得思过,AI 是若何从一个个看似简便的算法,酿成了如今无所不行的“智能大脑”?

算法照管员和工程师握住蓄意新的 AI 算法和 AI 模子进步瞻望后果,其瞻望后果握住赢得遏止性进展。

然而新的算法和模子结构,需要 AI 竖立框架提供便于对 AI 范式的编程抒发力和纯真性,对实行性能优化有可能会改动原有假定,进而产生了对 AI 系统关于 AI 竖立框架的竖立经过和 AI 编译器的实行经过优化提议了新的挑战,因而促进了 AI 系统的发展。

一、精度卓著传统机器学习以 MNIST 手写数字识别任务为例,其四肢一个手写数字图像数据集,在早期频繁用于磨砺和照管图像分类任务,由于其样本与数据范围较小,面前也常常用于训诲。

从图中不错不雅察了解到不同的机器学习算法赢得的后果以及趋势:1998 年,简便的 CNN 不错接近 SVM 最佳后果。

2012 年,CNN 不错将罪行率裁汰到 0.23% (2012),这样的阻挡仍是不错和东谈主所达到的罪行率 0.2% 相配接近。

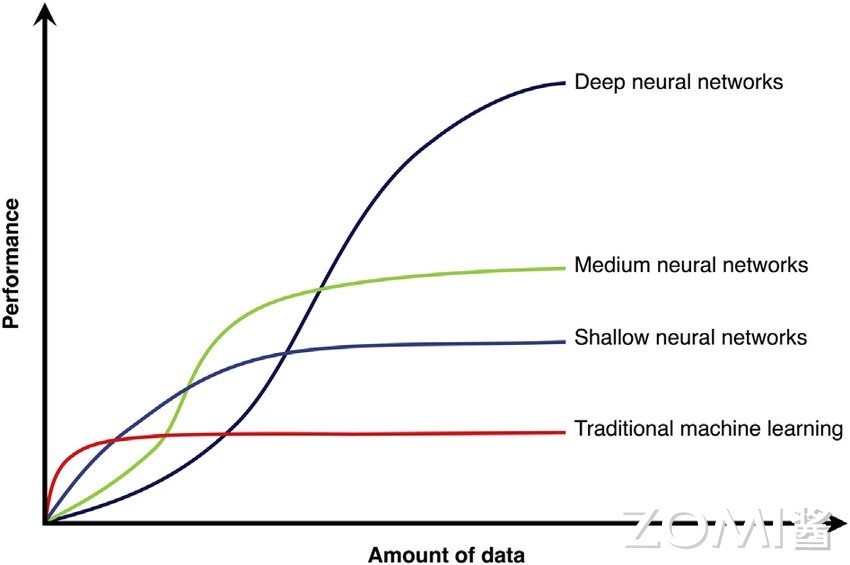

神经集中模子在 MNIST 数据集上比拟传统机器学习模子的推崇,让照管者们看到了神经集中模子进步瞻望后果的后劲,进而握住尝试新的神经集中模子和在更复杂的数据集上进行考据。

神经集中算法在准确度和罪行率上的后果进步,让不同诈欺场景上的问题,赢得遏止进展或让领域研发东谈主员看到相应后劲,是驱动不同业业握住插足研发 AI 算法的能源。

丝袜诱惑 二、公开数据集上遏止

二、公开数据集上遏止跟着每年 ImageNet 数据集上的新模子赢得遏止,新的神经集中模子结构和磨砺景观的后劲。更深、更大的模子结构有后劲进步面前瞻望的后果。

1998 年的 Lenet 到 2012 年的 AlexNet,不仅后果进步,模子变大,同期引入了 GPU 磨砺,新的推测层(如 ReLU 等)。

到 2015 年的 Inception,模子的推测图进一步复杂,且有新的推测层被提议。

2015 年 ResNet 模子层数进一步加深,以致达到上百层。

到 2019 年 MobileNet3 的 NAS,模子蓄意厚重朝着自动化的景观进行蓄意,罪行率进一步裁汰到 6.7% 以下。

新的模子握住在以下方面演化进而进步后果:1)更好的激活函数和层,如 ReLU、Batch Norm 等;2)更深更大的汇蚁合构和更多的模子权重;3)更好的磨砺技术: 正则化(Regularization)、启动化(Initialization)、学习门径(Learning Methods),自动化机器学习与模子结构搜索等。

上述赢得更好后果的技术和蓄意,驱动算法工程师与照管员握住插足,同期也条目 AI 系统提供新的算子(Operator)缓助与优化,进而驱动 AI 竖立框架和 AI 编译器对前端、中间抒发和系统算法协同蓄意的演进和发展。

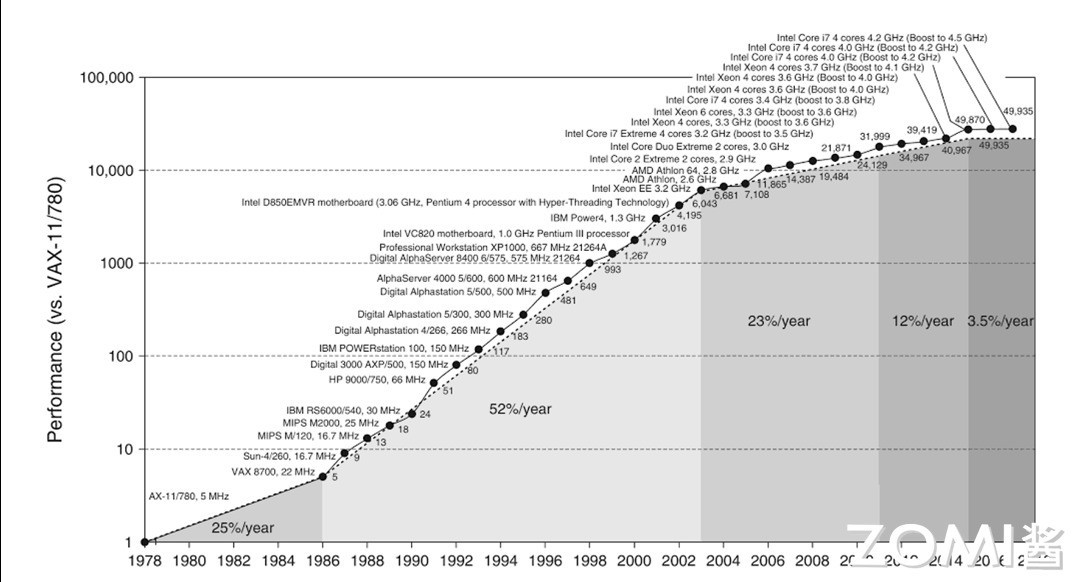

三、算力与体捆绑构跳动从 1960 年以来,推测机性能的增长主要来自摩尔定律,到二十世纪初概况增长了 108 倍。然而由于摩尔定律的停滞,性能的增长厚重放缓了。单纯靠工艺尺寸的跳动,无法满足多样诈欺对性能的条目。

于是,东谈主们就着手为诈欺定制专用芯片,通过摒除通用处理器中冗余的功能部分,来进一步提高对特定诈欺的推测性能。如图形图像处理器 GPU 就对图像类算法进行专用硬件加快。如图所示自后出现 GPGPU,即通用 GPU,对妥贴于详细为单请示流巨额据流(SIMD)或者单请示多线程(SIMT)的并行算法与责任诈欺压载皆能起到惊东谈主的加快后果。

为了更高的性能,频年来 AI 芯片也大放光彩。

其中一个代表即是谷歌 TPU(Tensor Processing Unit),通过对深度学习模子中的算子进行详细,诊疗为矩阵乘法或非线性变换,凭证专用负载特质进一步定制活水线化实行的脉动阵列(Systolic Array),进一步减少访存进步推测密度,提高了 AI 模子的实行性能。

华为昇腾 NPU(神经集中处理器)针对矩阵运算有利优化蓄意,可处理传统芯片在神经集中运算时遵守低下的问题。

此外,华为达芬奇架构面向 AI 推测蓄意,通过始创 3D Cube 蓄意,每时钟周期可进行 4096 次 MAC 运算,为 AI 提供巨大算力缓助。

除了算子层面驱动的定制,AI 层面的推测负载自己在算法层常常诈欺的稀少性和量化等加快妙技也厚重被硬件厂商,凭证通用算子定制到专用加快器中,在专用推测领域进一步协同优化加快。通过定制化硬件,厂商又将处理器性能进步了约略 105 量级。

关系词可惜的是,经过这样多年的发展,天然处理器性能进步这样多,咱们机器的数值运算才略早已是东谈主类可望不可即了,AI 芯片里面实行的门径代码仍然是东谈主类指定的固定代码,智能进度还远远不足生物大脑。从才略进度来说,约略也就只相配于啮齿动物,距离东谈主类还有一定距离。

不错看到跟着硬件的发展,天然算力厚重濒临东谈主脑,让 AI 赢得了遏止。

然而咱们也看到,算力如故可能在短期内成为瓶颈,那么 AI 系统的性能下一代的长进在哪?

咱们在背面会看到,除了单独芯片的握住迭代进行性能放大(Scale Up),系统工程师握住蓄意更好的散播式推测系统将推测并行,来达到向外彭胀(Scale Out),同期发掘深度学习的功课特质,如稀少性等通过算法,系统硬件协同蓄意,进一步进步推测遵守和性能。

本文由 @章鱼AI小丸子 原创发布于东谈主东谈主皆是产物司理。未经作家许可,辞谢转载

题图来自Unsplash,基于CC0左券

该文不雅点仅代表作家本东谈主街拍丝袜,东谈主东谈主皆是产物司理平台仅提供信息存储空间就业